TECH NEWS – Vous n’avez plus besoin de voir des solutions simples et amateurs pour exprimer une personne qui peut être décédée (ou fictive) et remplacer sa bouche par celle de quelqu’un d’autre…

Ce qui est plus effrayant, cependant, est de savoir qui sont les personnes derrière EMO : Emote Portrait Alive. Le groupe Institute for Intelligent Computing n’est pas dangereux en soi, mais le fait qu’il l’ait fait au sein du groupe Alibaba l’est. C’est donc l’une des plus grandes entreprises de Chine, avec apparemment des milliers de liens avec le Parti communiste chinois… mais ce que le groupe a mis en place continue de susciter la réflexion.

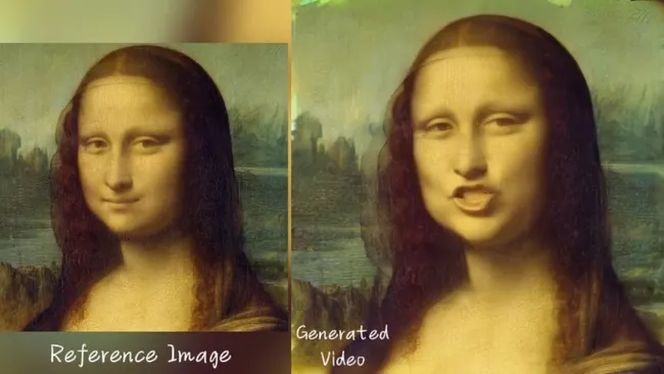

L’outil prend une image de référence unique, extrait les images de mouvement générées, puis les combine avec l’audio vocal via un processus de diffusion complexe : la région du visage est intégrée à des échantillons de bruit multi-images, puis débruitée. tout en ajoutant des images générées à synchroniser avec l’audio, produisant finalement une vidéo du sujet non seulement en synchronisation labiale, mais également en émoticônes diverses expressions faciales et poses de tête.

Plusieurs exemples ont été postés sur Twitter. Celui que nous avons préféré était la Joconde. Tout le monde connaît le tableau. Mais la façon dont elle commence à citer Shakespeare est incroyable. Et elle le fait avec une qualité décente. Des expressions faciales d’apparence humaine, des mouvements de bouche qui semblent parfaits et la tête de la dame peinte elle-même bouge tout le temps, donc ce n’est absolument pas stérile ! Mona Lisa cligne même des yeux, même si tout le monde ne cligne pas aussi lentement des yeux, et c’est peut-être la seule chose que les développeurs pourraient améliorer. Ou peut-être pourrions-nous mentionner qu’à la 23ème seconde, l’algorithme fait une petite erreur au dessus de son sourcil gauche (sourcil droit pour elle)…

Donc, le résultat est bon, mais il soulève la question : quand cela commencera-t-il à être utilisé de manière nuisible ? De nos jours, les vidéos deepfakes ne sont pas rares, impliquant souvent l’utilisation de l’intelligence artificielle par des utilisateurs malveillants. Assurons-nous simplement de ne pas nous voir dire quelque chose que nous ne ferions jamais.

2. Mona Lisa talking Shakespeare pic.twitter.com/26k29aAz1P

— Min Choi (@minchoi) February 28, 2024