TECH ACTUS – L’une des célébrités les plus importantes de notre époque, le scandale du faux porno IA de Taylor Swift – des images explicites fausses mais convaincantes de la chanteuse pop – a finalement attiré l’attention sur la dangerosité de l’utilisation de l’intelligence artificielle générative. Mais cet incident aura-t-il des conséquences considérables ?

Toute l’histoire du faux porno IA de Taylor Swift a commencé lorsque des deepfakes sexuellement explicites du chanteur ont commencé à circuler sur X le mercredi 24 janvier. NBC News a rapporté qu’ils avaient généré plus de 27 millions de vues en 19 heures avant la suspension du compte qui avait initialement publié les images. Une image a finalement atteint 47 millions de vues avant d’être supprimée.

Dans un message publié le 25 janvier, l’équipe de sécurité de X a déclaré que la société « supprimait activement » toutes les images identifiées de nudité indécente, qui, selon elle, étaient « strictement interdites » sur la plateforme.

Samedi 27 janvier, les recherches de « Taylor Swift » sur X ont renvoyé le message d’erreur suivant : « Quelque chose s’est mal passé. Essayez de recharger. » Cependant, les utilisateurs ont souligné que X bloque uniquement cette chaîne de texte spécifique ; la requête “Taylor Al Swift” est toujours autorisée sur X.

Concernant le changement visant à bloquer les recherches de Taylor Swift, Joe Benarroch, responsable des opérations commerciales de X, a déclaré : “Il s’agit d’une action temporaire et effectuée avec beaucoup de prudence car nous accordons la priorité à la sécurité sur cette question.”

Le lundi 29 janvier, X a finalement rétabli les recherches « Taylor Swift ». La possibilité de rechercher Taylor Swift sur la plateforme “a été réactivée et nous continuerons d’être vigilants face aux tentatives de diffusion de ce contenu et le supprimerons partout où nous le trouverons”, – a déclaré Joe Benarroch maintenant.

Des conséquences politiques ? La Maison Blanche et le Congrès américain réagissent à l’affaire du faux porno IA de Taylor Swift

Vendredi, la SAG-AFTRA a publié une déclaration condamnant les fausses images de Swift comme étant « bouleversantes, nuisibles et profondément préoccupantes ». Ils ont déclaré que “le développement et la diffusion de fausses images – en particulier celles à caractère indécent – sans le consentement de quelqu’un devraient être rendus illégaux”.

Dans une interview avec NBC News, le PDG de Microsoft, Satya Nadella, a qualifié les fausses images pornographiques de Swift d'”alarmantes et terribles” et a déclaré que “nous devons agir” et que “quelle que soit votre position sur une question particulière, je pense que nous en bénéficions tous”. le monde en ligne est un monde sûr. »

La Maison Blanche s’est également exprimée sur le sujet. Lorsqu’on lui a demandé si le président Biden soutiendrait une législation interdisant la pornographie générée par l’IA, la secrétaire de presse de la Maison Blanche, Karine Jean-Pierre, a répondu : « Nous sommes alarmés par les informations sur la circulation d’images que vous venez de présenter… Il devrait y avoir une législation, évidemment, pour régler ce problème. »

La députée démocrate de New York, Yvette D Clarke, a écrit sur X : “Ce qui est arrivé à Taylor Swift n’est pas nouveau. Depuis des années, les femmes ont été la cible de deepfakes [sans] leur consentement. Et [avec] les progrès de l’IA, créer des deepfakes est plus facile et moins cher. ” C’est un problème des deux côtés de l’allée et même les Swifties devraient pouvoir s’unir pour le résoudre. ”

Certains États américains ont leurs propres lois contre les deepfakes, mais ils sont de plus en plus nombreux à réclamer des modifications des lois fédérales.

En mai 2023, le député démocrate Joseph Morelle a présenté un projet de loi connexe. Dans un tweet condamnant les images de Swift, elle les a qualifiées d'”exploitation sexuelle”. La législation qu’il a proposée n’est pas encore entrée en vigueur.

Le député républicain Tom Kean Jr. a également condamné l’incident. Il a coparrainé le projet de loi de Morelle et a présenté sa propre loi sur l’étiquetage de l’IA, qui exigerait que tout le contenu généré par l’IA (y compris les chatbots plus inoffensifs utilisés dans les environnements de service client) soit étiqueté.

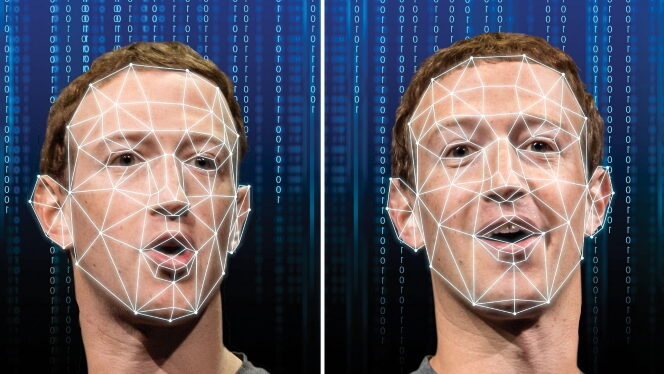

Des vidéos ou audio deepfakes convaincants ont déjà été utilisés pour usurper l’identité de certaines personnes de premier plan, en particulier des politiciens comme Donald Trump et Joe Biden et des artistes comme Drake and the Weeknd.

En octobre 2023, Tom Hanks a dit à ses abonnés Instagram de ne pas se laisser tromper par une fausse publicité dentaire à son effigie.

Cependant, la technologie s’adresse majoritairement aux femmes. De manière sexuellement exploitante : une étude de 2019 de DeepTrace Labs, citée dans le projet de législation américaine, a révélé que 96 % du contenu vidéo deepfake était du matériel pornographique non consensuel.

Pouvons-nous enfin prendre des mesures cohérentes contre les deepfakes et la portée excessive de l’IA ?

Le problème des deepfakes n’est pas un phénomène nouveau. Le faux porno est possible depuis plus de deux décennies grâce à des logiciels comme Photoshop. Mais ce n’est que récemment que la production est devenue aussi rapide et facile pour quiconque, car diverses applications permettent, par exemple, de remplacer le visage d’une personne par un autre corps.

Mais aujourd’hui, de plus en plus de gens – y compris les autorités – y prêtent attention puisque la dernière victime en date est Swift, choisi par le magazine Time comme personnalité de l’année, qui a contribué à hauteur de 0,5 point de pourcentage au PIB américain, qui a commencé une guerre avec les services de streaming d’entreprises telles que Apple Inc. et gagnée et qui a augmenté l’audience du football féminin.

Les législateurs ont été indignés, tandis que des légions de fans de Swift avaient tendance à « protéger Taylor Swift » sur X. Certains ont eu recours à l’autocensure, désignant un utilisateur de Twitter qui serait derrière de nombreuses images interdites. Swift envisagerait d’intenter une action en justice contre un site pornographique deepfake qui en a publié certains, rapporte le Daily Mail.

Swift n’est pas du genre à privilégier les solutions à moitié vaines, nous n’assisterons donc peut-être pas à un seul procès. Peut-être sera-t-il à l’origine des projets de loi déjà en préparation au Congrès, qui lutteront contre les deepfakes non autorisés.

Un projet de loi rendrait illégal la prise et le partage de telles images, tandis qu’un autre proposait cinq ans de prison pour les auteurs et des recours juridiques pour les victimes.

Il y a de l’espoir pour une solution. Certaines des mesures adoptées par le Congrès peuvent être considérées comme un début. Même si les règles à long terme sont encore en cours d’élaboration, les autorités peuvent pour l’instant garder la situation sous contrôle en faisant un exemple des pires contrevenants. Les moyens de dissuasion peuvent fonctionner. Même pour les personnes qui pensent pouvoir se cacher derrière le couvert de l’anonymat en ligne. Un excellent exemple en est le groupe hacktiviste en ligne Anonymous, dont les activités ont cessé presque immédiatement après qu’une poignée de hackers les plus célèbres aient été arrêtés et identifiés il y a dix ans. Un utilisateur de Twitter a déjà admis avoir publié certaines des premières images virales : “Frère, qu’est-ce que j’ai fait… Ils pourraient adopter de nouvelles lois à cause de mon message sur Taylor Swift”, rapporte Newsweek, avant de rendre son compte privé.

Source : NBC, Newsweek, The Daily Mail, The Guardian, Variety

![MotoGP 26 : les bolides seront encore au rendez-vous cette année [VIDEO]](https://thegeek.site/wp-content/uploads/sites/3/2026/03/theGeek-MotoGP-26-302x180.jpg)

![MotoGP 26 : les bolides seront encore au rendez-vous cette année [VIDEO]](https://thegeek.site/wp-content/uploads/sites/3/2026/03/theGeek-MotoGP-26-300x365.jpg)